Importer une vidéo

ou sélectionner depuis

Formats acceptés : MP4, MOV. 100 Mo max.

Importer une image

ou sélectionner depuis

Formats acceptés : PNG, JPG. 10 Mo max.

Chargement...

Suite Créative : Outils de Génération Vidéo IA et Génération Image IA

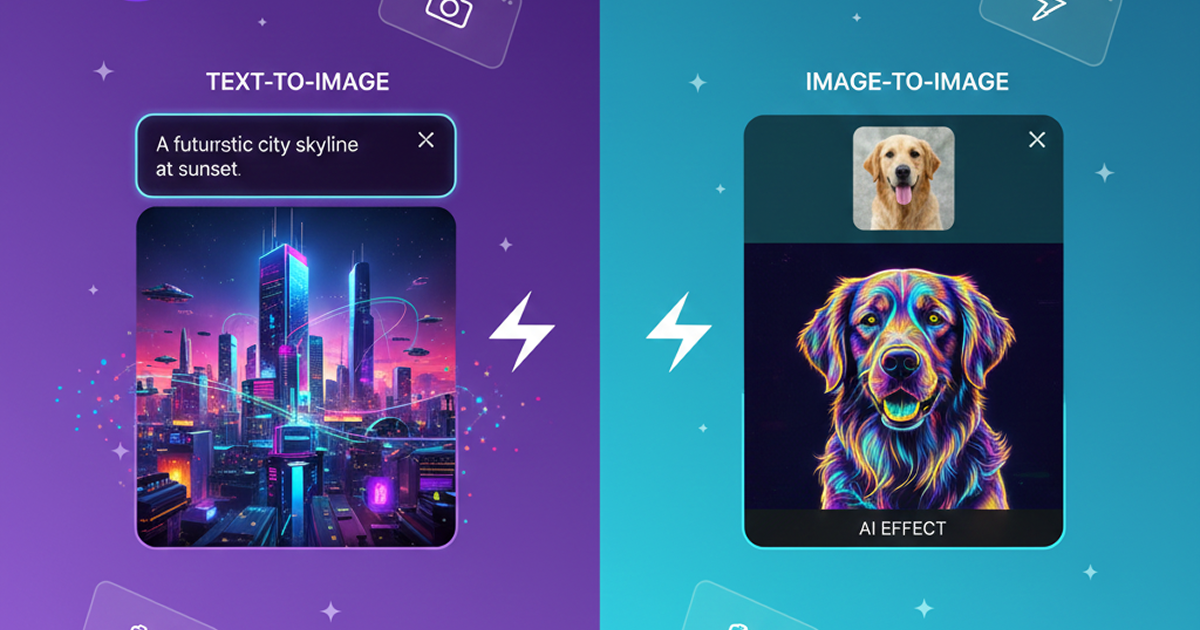

Boostez votre flux de travail créatif avec nos outils alimentés par l'IA. Générez des vidéos époustouflantes, créez des images et appliquez des ajustements personnalisés - notre Générateur Vidéo IA et Générateur Image IA offrent une solution complète pour tous vos besoins créatifs.

Kling Motion Control

Fini les devinettes pour l'animation. Kling Motion Control copie une performance humaine réelle à l'identique et l'applique à n'importe quel personnage, comme la capture de mouvement sans la combinaison. Importez une image de personnage et une vidéo de référence, et l'IA suit chaque position du corps, geste de la main et expression faciale image par image. Générez de 3 à 30 secondes d'animation continue en 720p ou 1080p. Une seule performance, des personnages illimités. Mêmes gestes, même rythme, même énergie, mais des identités visuelles différentes. Essai gratuit avec 10 crédits.

Essayer gratuitementCopiez le mouvement humain réel image par image

Filmez quelqu'un en train de danser, présenter ou gesticuler. Kling Motion Control suit chaque position du corps, mouvement de main et expression faciale, puis transfère cette performance exacte à votre personnage. Le timing reste synchronisé : une référence de 12 secondes devient une animation de personnage parfaite de 12 secondes.

Une performance, des personnages illimités

Filmez-vous une seule fois, puis appliquez cette performance à 10 personnages différents avec Kling Motion Control. Mêmes gestes, même rythme, même énergie, mais des identités visuelles différentes. Parfait pour les mascottes de marque, les tests A/B de design de personnages ou la production de contenu multilingue avec un langage corporel cohérent.

30 secondes de mouvement continu

Kling Motion Control génère jusqu'à 30 secondes en une seule prise. Assez long pour des démos produit complètes, des chorégraphies entières ou des présentations sans interruption. Pas de coupures gênantes où le mouvement se réinitialise, juste une action fluide et continue du début à la fin. La plupart des autres outils plafonnent à 5-10 secondes.

Où Kling Motion Control est réellement utilisé

Des cas d'utilisation concrets où le transfert de performance surpasse l'animation basée sur des prompts.

Démos produit avec des présentateurs cohérents

Enregistrez une seule vidéo de démonstration, appliquez-la à différents personnages de marque avec Kling Motion Control. Chaque démo conserve les mêmes gestes, le même rythme et la même énergie, mais avec des identités visuelles différentes. Plus rapide que de filmer plusieurs prises.

Présentateurs virtuels et influenceurs IA

Votre personnage virtuel doit paraître naturel à l'écran. Enregistrez-vous en jouant le script, puis utilisez Kling Motion Control pour transférer cette performance. Langage corporel, timing, expression : tout est copié depuis de vrais humains.

Transfert de danse et chorégraphie

Capturez des séquences de danse, appliquez-les à des personnages illustrés ou stylisés avec Kling Motion Control. Idéal pour les clips musicaux, le contenu social ou les projets d'animation où vous souhaitez une vraie chorégraphie avec des styles artistiques non réalistes.

Vidéos de formation avec des actions reproductibles

Filmez un instructeur démontrant un processus une seule fois. Réutilisez cette performance exacte avec Kling Motion Control dans différents scénarios, langues ou designs de personnages. Les gestes et le timing restent cohérents.

Contenu de personnages pour les réseaux sociaux

Créez du contenu engageant centré sur des personnages pour TikTok, Instagram et YouTube. Kling Motion Control vous permet de produire des performances de personnages cohérentes qui correspondent aux danses, réactions et formats tendance.

Production de contenu multilingue

Le même langage corporel dans toutes les langues. Enregistrez une performance, utilisez Kling Motion Control pour l'appliquer à des personnages pour différents marchés. Des gestes et un timing cohérents quelle que soit la langue de la voix off.

Ce que fait réellement Kling Motion Control

Vous avez une vidéo de référence de quelqu'un qui danse, présente ou fait simplement un signe de la main. Vous avez un personnage, que ce soit une photo, une illustration ou un rendu 3D. Kling Motion Control transpose les mouvements exacts de cette vidéo sur votre personnage. C'est comme la capture de mouvement sans la combinaison. L'IA suit les positions du corps, les gestes des mains, les expressions faciales, et même les subtils transferts de poids et le timing, puis applique tout cela à votre image. Votre personnage exécute les mêmes actions avec le même rythme et la même énergie. Ce n'est pas de l'animation basée sur des prompts où vous décrivez 'personne qui fait signe'. Kling Motion Control est du transfert de performance. Si votre vidéo de référence montre quelqu'un faisant une démonstration produit de 12 secondes avec des gestes spécifiques aux secondes 3, 7 et 10, votre personnage fera ces gestes exacts à ces moments précis.

Pourquoi Kling Motion Control surpasse les autres méthodes

Les outils texte-vers-vidéo devinent le mouvement à partir de prompts. L'image-vers-vidéo ajoute une animation subtile. Kling Motion Control est différent : il copie une performance humaine réelle à l'identique. Si vous avez besoin d'une chorégraphie précise, de gestes spécifiques ou d'actions reproductibles sur plusieurs personnages, c'est l'outil qu'il vous faut.

Mouvement du corps entier synchronisé

Bras, jambes, torse, tête : Kling Motion Control fait tout bouger ensemble comme un vrai mouvement. L'IA préserve la coordination corporelle, donc la marche ressemble à de la marche et la danse ressemble à de la danse. Chaque partie du corps reste synchronisée.

Des gestes de mains nets et précis

Pointer, compter sur les doigts, tenir des objets : Kling Motion Control garde les mouvements de mains clairs. La plupart des IA vidéo ont du mal avec les mains, mais le contrôle de mouvement copie depuis de vraies séquences où les mains fonctionnent déjà correctement.

30 secondes d'action continue

Générez jusqu'à 30 secondes en une seule prise avec Kling Motion Control. Assez long pour des démonstrations complètes, des séquences de danse entières ou des présentations sans coupure. Pas de transitions gênantes où le mouvement se réinitialise, juste une prise fluide.

Même mouvement, différents personnages

Enregistrez une performance, appliquez-la à plusieurs personnages avec Kling Motion Control. Idéal pour les mascottes de marque, les présentateurs virtuels ou les tests A/B de différents styles visuels avec des mouvements identiques.

Photos, illustrations, rendus 3D

Kling Motion Control fonctionne avec n'importe quelle image de personnage : photographies, illustrations numériques, art style anime, rendus 3D. Tant que le corps est visible, l'IA peut l'animer avec votre mouvement de référence.

Sortie en 720p et 1080p

Kling Motion Control génère en qualité HD. Le mode Standard pour un traitement efficace, le mode Pro pour un rendu plus net et une qualité visuelle supérieure. Le comportement du mouvement est identique dans les deux cas, le mode Pro est simplement plus net.

Comment utiliser Kling Motion Control

Quatre imports et vous êtes prêt à générer

Importez votre image de personnage

PNG ou JPG, minimum 512x512 pixels. Le personnage doit montrer clairement la tête, les épaules et le torse. Vue de face ou léger angle pour de meilleurs résultats. Illustrations, photos et rendus 3D fonctionnent tous avec Kling Motion Control.

Importez votre vidéo de référence de mouvement

MP4, MOV ou MKV jusqu'à 10 Mo. 3 à 30 secondes de quelqu'un exécutant l'action souhaitée. Meilleurs résultats : une seule personne, mouvement clair, caméra stable. Kling Motion Control suit automatiquement le sujet principal.

Ajustez le cadrage et ajoutez une description de scène

Une image mi-corps nécessite une vidéo mi-corps. Corps entier nécessite corps entier. Décrivez optionnellement l'arrière-plan et l'environnement : Kling Motion Control gère le décor séparément du mouvement.

Choisissez la qualité et générez

Mode Standard (70-140 crédits) pour un traitement efficace. Mode Pro pour un rendu plus net. Le traitement Kling Motion Control prend 2 à 4 minutes. Téléchargez votre vidéo en MP4 propre sans filigrane.

Fonctionnalités de Kling Motion Control

Tout ce dont vous avez besoin pour un transfert de mouvement professionnel depuis une vidéo de référence vers une animation de personnage.

Suivi de mouvement image par image

Kling Motion Control suit les positions du corps, les gestes des mains et les expressions faciales sur chaque image de votre vidéo de référence. Le timing du mouvement est préservé exactement tel qu'il a été exécuté.

Génération de 3 à 30 secondes

Générez de 3 à 30 secondes d'animation continue avec Kling Motion Control. Pas de raccords, pas de réinitialisations, pas de coupures : une seule prise fluide correspondant à la durée de votre vidéo de référence.

Application multi-personnages

Une vidéo de référence, des applications de personnages illimitées. Kling Motion Control vous permet de réutiliser la même performance sur différents personnages sans réenregistrer le mouvement.

Contrôle de scène par prompt

Le mouvement vient de la vidéo, mais vous contrôlez l'environnement avec le système de prompts de Kling Motion Control. Décrivez les arrière-plans, l'éclairage et les décors indépendamment du mouvement du personnage.

Modes de qualité Standard et Pro

Kling Motion Control propose le mode Standard pour un traitement économique et le mode Pro pour une qualité visuelle maximale. Les deux produisent un mouvement identique, le mode Pro offre un rendu plus net.

Sortie prête pour un usage commercial

Chaque vidéo Kling Motion Control s'exporte en MP4 propre sans filigrane. Droits commerciaux complets inclus : utilisez-la pour du travail client, les réseaux sociaux, le marketing ou tout usage professionnel.

Ce que les créateurs disent de Kling Motion Control

Créateurs de contenu, marketeurs et animateurs utilisent Kling Motion Control sur Domer pour l'animation professionnelle de personnages.

Kling Motion Control a changé ma façon de créer du contenu avec des personnages. Je m'enregistre en train de faire les actions, je les transfère à ma mascotte de marque, et le mouvement est parfait à chaque fois. Plus besoin de deviner avec des prompts textuels.

David Chen, Créateur de contenu

David Chen

Créateur de contenu

Nous utilisons Kling Motion Control pour les vidéos de démo produit sur 4 marchés. On filme un présentateur, on applique le mouvement à différents personnages pour chaque région. Mêmes gestes, message cohérent, une fraction du coût de production.

Rachel Kim, Responsable marketing

Rachel Kim

Responsable marketing

30 secondes de mouvement continu en une seule prise, c'est ce qui m'a convaincu d'adopter Kling Motion Control. Les autres outils offrent 5 secondes maximum. Je peux faire une chorégraphie complète ou une présentation produit entière sans coupures.

Marcus Thompson, Animateur freelance

Marcus Thompson

Animateur freelance

Les intros de mon présentateur virtuel avaient l'air robotiques. Avec Kling Motion Control, je m'enregistre en faisant l'intro naturellement, je la transfère à mon personnage, et le langage corporel semble vraiment humain. Les spectateurs ont remarqué la différence immédiatement.

Sofia Garcia, Créatrice YouTube

Sofia Garcia

Créatrice YouTube

Une mascotte de marque qui fait des démos produit avec de vrais gestes humains, Kling Motion Control rend cela possible. On filme une démo, on l'applique à notre personnage mascotte, et on a une vidéo professionnelle prête en quelques minutes.

James Wilson, Propriétaire e-commerce

James Wilson

Propriétaire e-commerce

Les tendances de danse TikTok avec nos personnages de marque, c'est ce que Kling Motion Control nous permet de faire. On enregistre la chorégraphie une fois, on l'applique à différents personnages pour chaque compte. La qualité du mouvement est vraiment impressionnante.

Anna Zhang, Responsable réseaux sociaux

Anna Zhang

Responsable réseaux sociaux

FAQ Kling Motion Control

Questions fréquentes sur le transfert de mouvement

Dernières actualités

Conseils, tutoriels et mises à jour de l'équipe Domer AI.

How to Create Professional TikTok Videos with Nano Banana 2 AI Image Generator and Kling 3.0 AI Video Generator

Complete step-by-step guide: Use Nano Banana 2 AI image generator to create stunning images, then transform them into professional videos with Kling 3.0 AI video generator. Perfect for TikTok, Instagram Reels, and YouTube Shorts. Free tutorial with examples, prompts, and parameters.

Baby Brat Meme Generator: How to Create Cursed-Cute AI Images

Complete guide to creating Baby Brat memes—the cursed-cute trend combining baby filters with brat aesthetics. Get the best AI prompts, tools, and tips for viral-worthy images.

Domer: Free AI Image Generator - Complete Features & Guide

Everything you need to know about Domer AI—a fast, free image generator for creating memes, art, and transformations. Get 10 free credits to start.

FLUX.2: The End of Five Designer Nightmares

FLUX.2 solves the problems that made AI image tools frustrating—exact colors, consistent characters, readable text, print quality, and efficient workflows. Here's what actually changed.

From Kling 2.6 to 3.0: How One AI Video Platform Is Rethinking the Entire Workflow

While competitors race for longer videos and higher resolution, Kling is betting on something different with its AIO model—and it might just work. A deep dive into Kling 3.0's unified approach.

Kling Motion Control: Transfer Motion from Video to Image with AI

Learn how Kling Motion Control works - upload a reference video and static image to create videos with transferred motion. Complete guide with examples and tips.

What Is Domer Meme? The Baby Bart Simpson Phenomenon Explained

A deep dive into the Domer meme that took over TikTok in late 2025. Learn what 'Domer' means, why it went viral, and how to create your own Domer-style images with AI.

Essayez Kling Motion Control gratuitement

10 crédits gratuits pour commencer. Importez un personnage et une vidéo de référence, découvrez comment fonctionne Kling Motion Control. Aucun paiement requis tant que vous ne souhaitez pas générer davantage.